语言模型训练中的熵指标:如何理解模型预测的不确定性

一句话总结 在语言模型训练中,entropy 衡量的是模型对下一个 token 概率分布的“不确定性”:熵越高,说明概率越分散、模型越犹豫;熵越低,说明概率越集中、模型越自信。 什么是熵 熵(Entropy)来自信息论,用来衡量一个概率分布的不确定性。 放到语言模型里,它描述的是:模型在预测“下一个 token”时,到底是很确定地把概率压在少数 token 上,还是把概率分散给了...

一句话总结 在语言模型训练中,entropy 衡量的是模型对下一个 token 概率分布的“不确定性”:熵越高,说明概率越分散、模型越犹豫;熵越低,说明概率越集中、模型越自信。 什么是熵 熵(Entropy)来自信息论,用来衡量一个概率分布的不确定性。 放到语言模型里,它描述的是:模型在预测“下一个 token”时,到底是很确定地把概率压在少数 token 上,还是把概率分散给了...

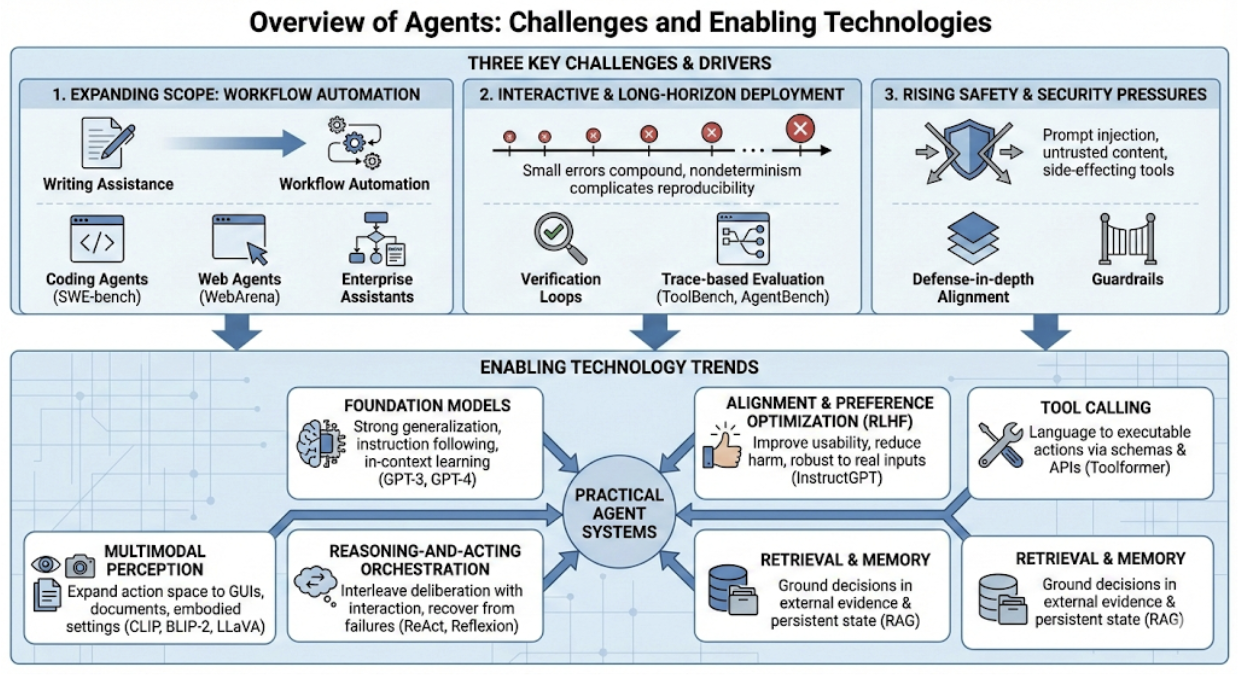

论文信息 标题: AI Agent Systems: Architectures, Applications, and Evaluation 作者: Bin Xu (Arizona State University) 发布: 2025 arXiv: 2601.01743 一句话总结 本文系统性综述了 AI Agent 系统的完整技术栈,提...

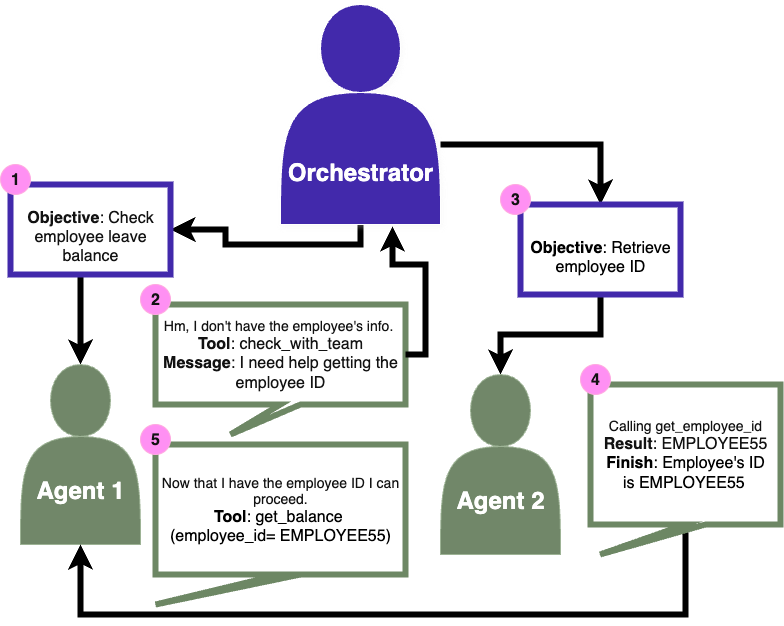

论文信息 标题: AgentArch: A Benchmark for Evaluating Agent Architectures in Enterprise Workflows 作者: Tara Bogavelli, Hari Subramani, Roshnee Sharma (ServiceNow) 发布: 2025 GitHub: Servic...

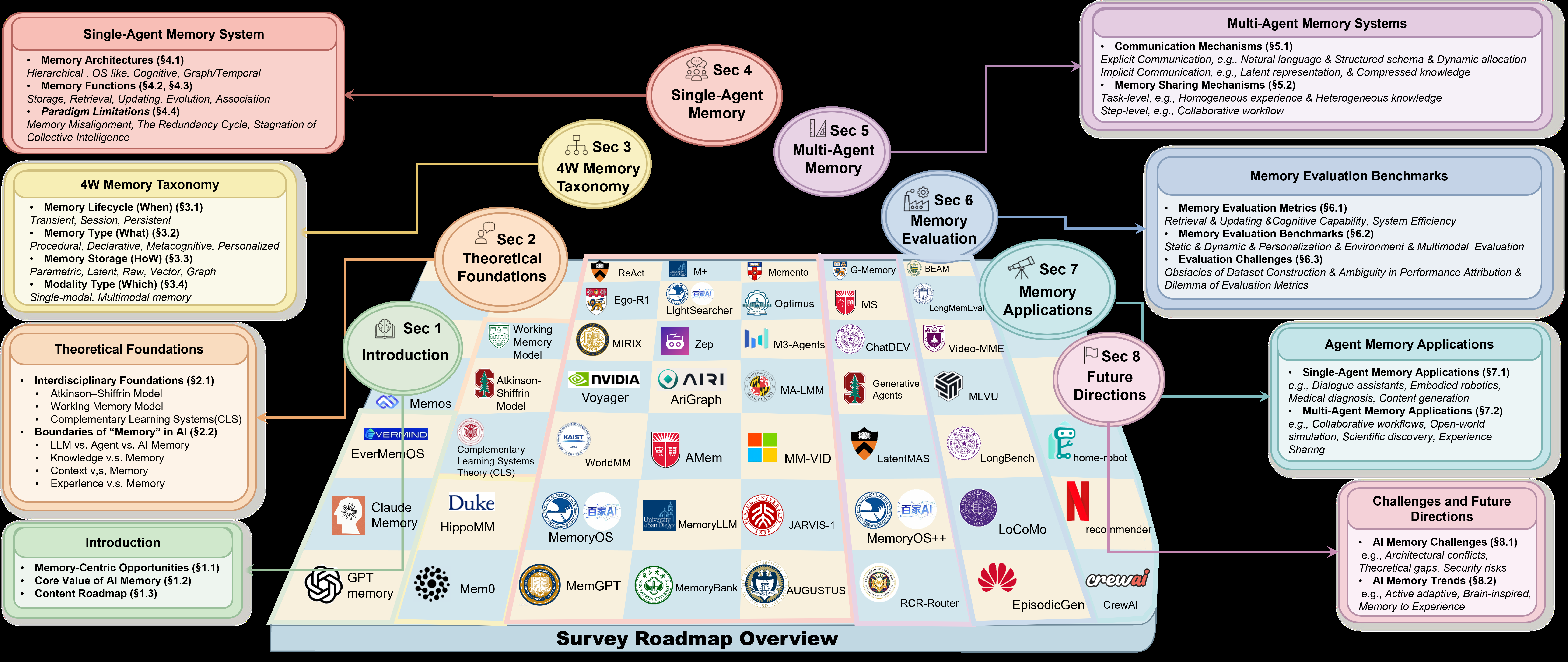

论文信息 标题: Survey on AI Memory: Theories, Taxonomies, Evaluations, and Emerging Trends 作者: Ting Bai, Jiayang Fan, Xiaoshuai Wen et al. 机构: BaiJia AI Team, 北京邮电大学,华为技术有限公司 发布: 2026/...

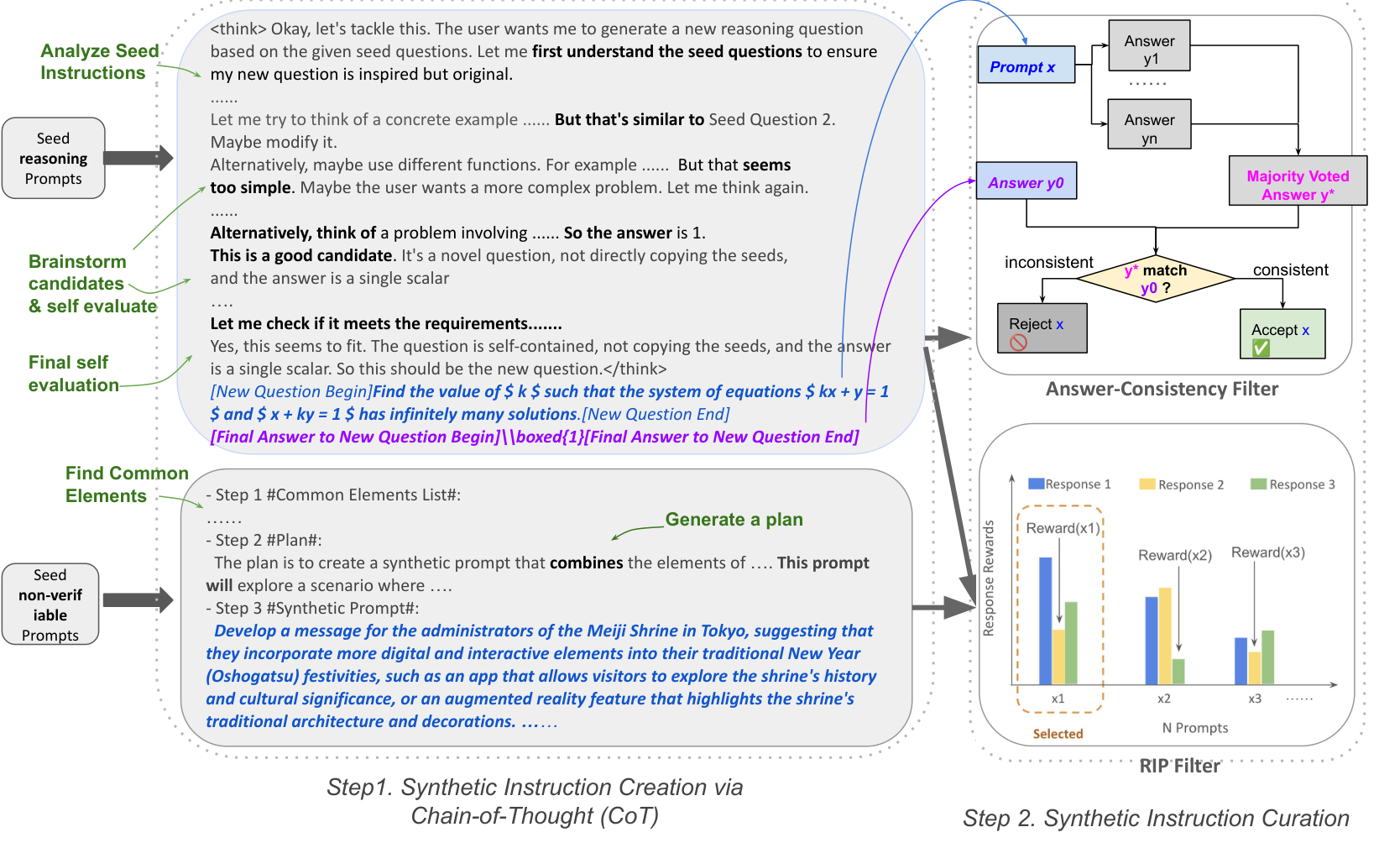

论文信息 标题: CoT-Self-Instruct: Building High-Quality Synthetic Data for Reasoning and Non-Reasoning Tasks 作者: Ping Yu et al. (FAIR at Meta, NYU) 会议: ICLR 2025 arXiv: 2507.23751 ...

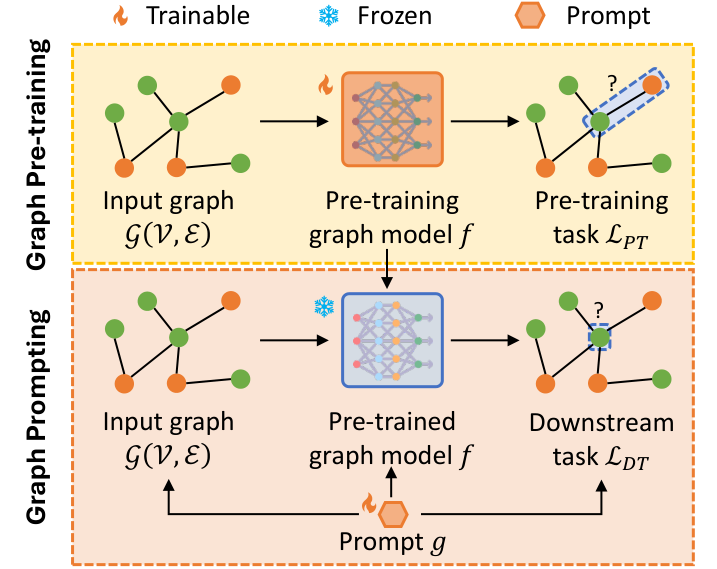

论文信息 标题: Graph Prompting for Graph Learning Models: Recent Advances and Future Directions 作者: Xingbo Fu, Zehong Wang, Zihan Chen et al. (University of Virginia, University of Notre Dame,...

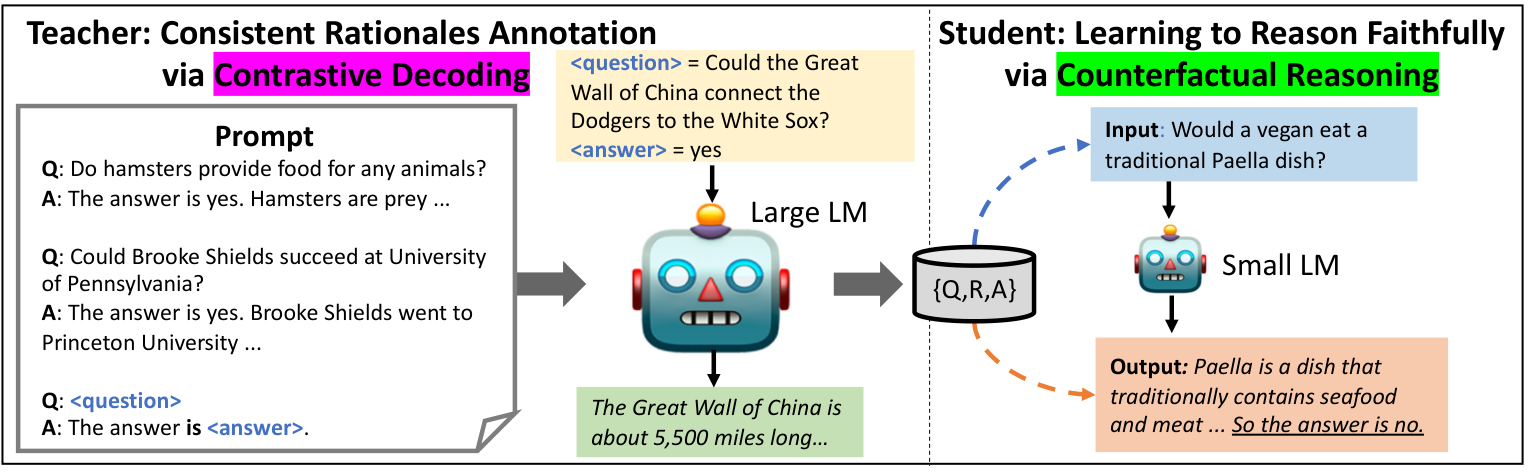

论文信息 标题: SCOTT: Self-Consistent Chain-of-Thought Distillation 作者: Peifeng Wang et al. (USC, Amazon) 会议: ACL 2023 arXiv: 2305.01879 代码: GitHub 📊 本文插图 Figure 1: GP...

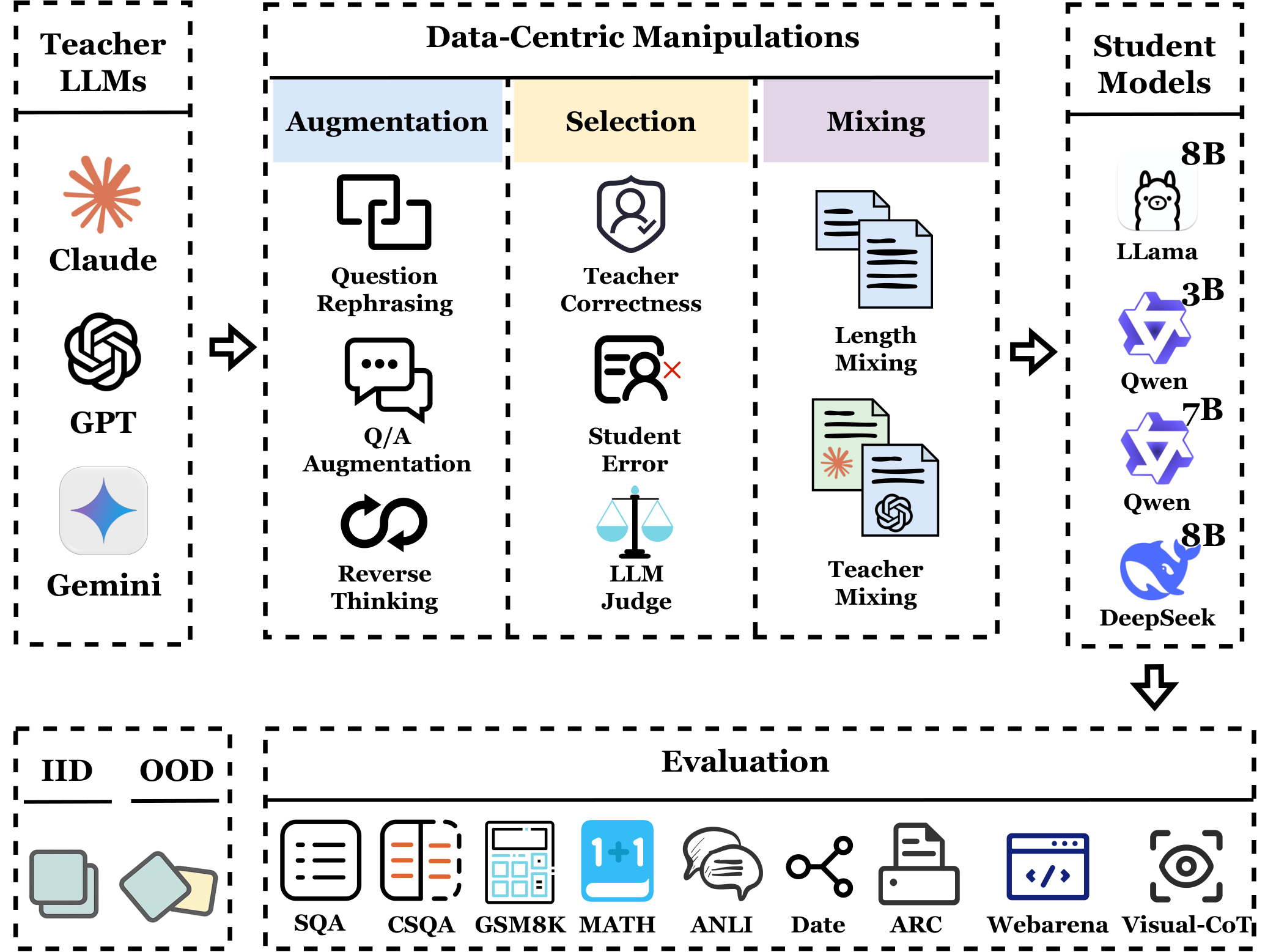

论文信息 标题: The Quest for Efficient Reasoning: A Data-Centric Benchmark to CoT Distillation 作者: Ruichen Zhang et al. (UNITES Lab) arXiv: 2505.18759 代码: GitHub - Distillation-Bench ...

数组和链表的理论基础与对比 一、数组(Array) 基本概念 连续的内存空间,存储相同类型元素。 通过索引直接访问元素(时间复杂度 O(1))。 大小固定,需预分配内存;扩容需重新分配内存并拷贝数据。 核心操作复杂度 访问:O(1)(随机访问) 插入/删除:O(n)(需移动元素) ...

以下是四种主要模型架构的详细中文解析: 1. 编码器-解码器架构(Encoder-Decoder) 结构:包含编码器(处理输入)和解码器(生成输出)。 典型任务:序列到序列(seq2seq)任务,如机器翻译、文本摘要。 代表模型:T5、BART、原始Transformer。 工作原理: 编码器:通过双向注意力(能看到全部上下文)将输入转换为稠密的...